(来源:财联社)

财联社8月6日讯(编辑 史正丞)OpenAI首席执行官山姆·奥尔特曼周二宣布,公司将在未来几天里带来许多新东西,其中周二会迎来一项“小而重磅”的更新——预热已久的开源模型GPT-OSS。

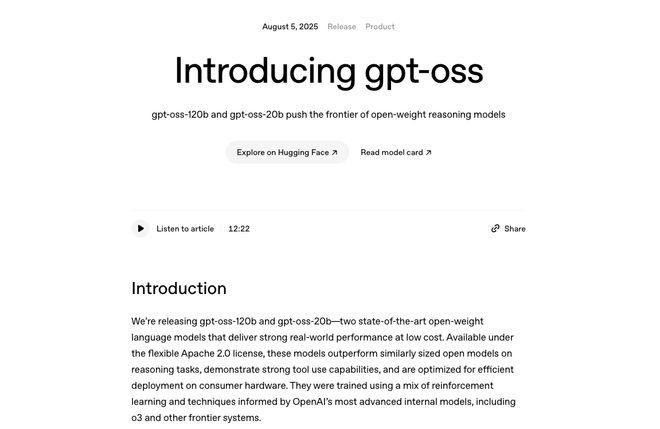

简单而言,OpenAI周二共发布两款开放权重AI推理模型。其中参数量达到1170亿的gpt-oss-120b能力更强,可以由单个英伟达专业数据中心GPU驱动;参数量210亿的gpt-oss-20b模型,则能够在配备16GB内存的消费级笔记本电脑上运行。

虽然公司名字叫OpenAI,但这已经是2019年的GPT-2后,这家AI初创公司时隔6年首度推出开源模型。在今年1月DeepSeek引爆开源AI风暴后,奥尔特曼曾认错称OpenAI在开源技术方面“站在了历史的错误一边”,这正是OpenAI重新推出开源模型的原因。

两款模型都以宽松的Apache 2.0许可证发布,企业在商用前无需付费或获得许可。

就模型性能而言,GPT-OSS大致位于开源模型的第一梯队,但整体略逊于自家的GPT-o3和o4-mini。

例如在Codeforces(带工具)的编程测试中,gpt-oss-120b和gpt-oss-20b的“跑分”分别为2622和2516分,但还是比不过头部闭源推理模型。

类似的情况也发生在“人类最后的考试”测试中,两款开源模型的得分分别为19%和17.3%,同样比不过o3。

与闭源模型类似,两款开放模型都采用了混合专家(MoE)技术,处理问题时只会激活较少的参数。对于1170亿参数量的gpt-oss-120b,处理每一个token时仅激活51亿个参数。

值得注意的是,相较o3和o4-mini模型,两款开放模型也会出现更多的幻觉。OpenAI解释称,由于较小的模型拥有的世界知识比大型前沿模型少,所以更容易产生幻觉也在意料之中。在OpenAI内部用于衡量模型对人物知识准确性的PersonQA基准测试中,gpt-oss-120b和gpt-oss-20b分别对49%和53%的问题产生幻觉,达到o1模型的3倍多,也高于o4-mini模型的36%。

顺便一提,作为毫无惊喜的预告,奥尔特曼同时强调本周晚些时候会有一项“重大更新”。鉴于公司这段日子不断吊业界胃口的举动,市场普遍预期OpenAI下一个重磅更新将是推出GPT-5。